/Поглед.инфо/ В новия си доклад експертите от университета Корнел говориха за рисковете, свързани с все по-активното въвеждане на изкуствен интелект в ядрените оръжия, съобщава Daily Mail. Според учените машините могат да „излязат от контрол“ и да провокират „апокалиптична война“, така че е по-добре да оставите основните решения в използването на ядрените оръжия на хората.

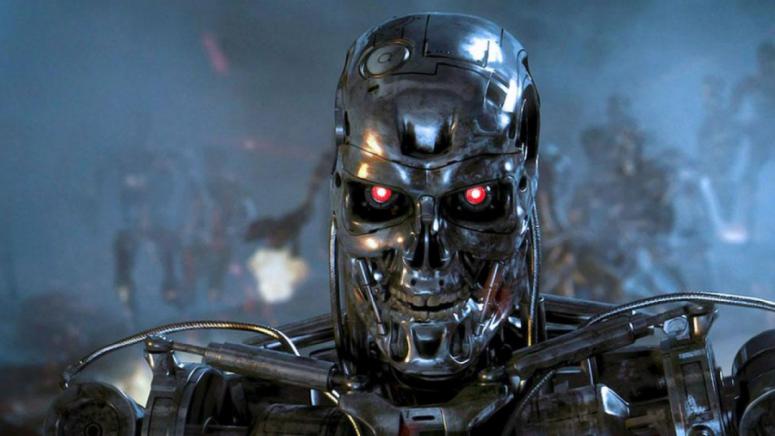

Учените предупреждават, че прехвърлянето на контрола над ядрените оръжия върху изкуствения интелект може да завърши с „ апокалиптична война в стила на Терминатора “, съобщава „Дейли мейл“.

В новия си доклад експерти от американския университет Корнел от Ivy League твърдят, че непрекъснато нарастващото преминаване към автоматизация и роботика може да накара машините да „ излязат от контрол “ и да обявят война на човечеството - точно както в сериите от научна фантастика филми на Терминатор с Арнолд Шварценегер.

Според експерти, опитвайки се да „ настигнат САЩ по отношение на военния потенциал “, Русия и Китай започват да разчитат повече на технологиите за изкуствен интелект, които в бъдеще могат да представляват рискове, които дори не са известни на света. Така че Москва вече е започнала работа по безпилотното торпедо на ядрената подводница "Посейдон", известна по-рано като Status-6.

Освен това страните могат да решат по-активно да използват изкуствен интелект в системите за ранно предупреждение. И тук, както напомнят учените, историята ни показва, че рисковете също могат да бъдат големи. Мнозина са наясно с инцидента от 1983 г., когато съветският офицер Станислав Петров игнорира сигнала на системата за изстрелване на американски ракети. Петров разбра, че сигналът е фалшив и по този начин спаси света от възможна ядрена война между САЩ и Русия.

Експертите признават, че под някаква форма компютризацията на ядрените оръжия може да повиши надеждността и стабилността на такива системи. Изкуственият интелект може да събира данни и да извършва анализ, който след това ще бъде използван от военното ръководство.

„Когато модернизираме ядрените арсенали, ръководството трябва да се стреми да използва компютърни системи, за да намали рисковете от случайни инциденти, фалшиви аларми и да засили човешкия контрол върху операциите с ядрено оръжие “, препоръчват учените.

Превод: Поглед.инфо